DeepSeek R1发布一个月后的想法

DeepSeek R1发布快一个月了,各方观点都发表的差不多了,写写我的想法

DeepSeek-V3和R1发布,颠覆了美国科技圈三个认知:

- 中国做不出独立创新性成果

- Scaling law需要指数级的增加算力

- 前沿大模型一定要是闭源的

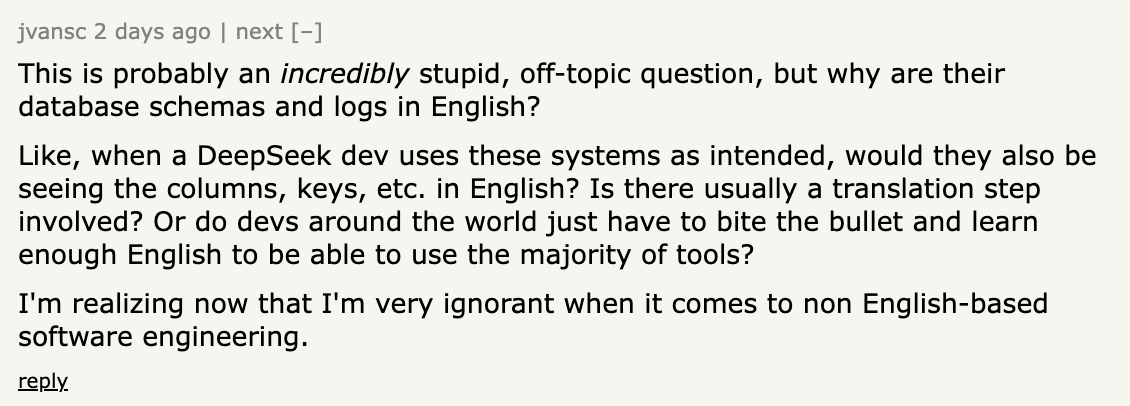

关于第一点,只能说average美国人对美国以外的世界了解还是有限。前几天HackerNews有一篇关于DeepSeek的一个Clickhouse数据库节点泄露的帖子,文章里有一些数据库schema的截图(比如log_stream, metrics_stream),下边有这么一条评论让我啼笑皆非。中国还是经济落后的第三世界啊,怎么可能会读写英语,怎么可能作出创新的大模型。

吐槽过第一点,第二点和第三点究竟是否应该被推翻,我觉得是有待论证的。

需要指数级的增加计算资源吗

首先,对计算资源的崇拜的共识是过去十年甚至三十年里被反复验证的,强化学习先驱Rich Sutton在2019年的短文The bitter lesson里就简明扼要的指出AI能力的质变几乎每次都来自于更多的计算,而不是通过优化带来的量变。

从另一个角度来讲,既然scaling law还没有显著的见顶,那买显卡堆计算就主要是一个经济项目。只要ROI说得通,就有金主愿意砸钱。相对的,DeepSeek V3/R1主要解决的是在给定计算上限(被美国卡脖子)的条件下,怎么最大化训练和推理效率的优化问题。做优化是一个科研项目,科研项目的不确定性更大,对人才的要求更高(DeepSeek的研究员牛逼!)。科研问题还不能证伪,如果一个团队投入了大量人力物力还是没做出成果,也不能说这个成果是做不成的。在OpenAI,Anthropic,Google的研究员们都是经过过去二十年的学术熏陶,一篇一篇paper做到现在的,难道不明白有很多优化可以做?只不过大家形成了共识,先把买显卡堆计算这条路推到极点,发现能发现的所有emergent abilities,然后再回头做优化也来得及。所以五千亿美元的stargate还是会进行下去,Nvidia的股票还能再长。

当然了,这是从纯科研的角度想问题。DeepSeek厉害的一点是让模型的推理阶段成本更低,需要的硬件资源更少,正投资本家们的下怀,所以我们才看到微软和阿里这些自己有自研大模型的公司争先恐后的部署DeepSeek,以及最近的微信接入DeepSeek。这个事情通过Jevons Paradox反过来又会继续刺激需求端的暴增,继续利好Nvidia。

前研大模型要开源吗

先说结论,我认为现有模式的开源模型(只给模型参数,不给训练数据和过程代码),主要的价值来自于营销推广,长期的商业护城河还有点观察。(这里我们只讲商业策略,不讲安全性问题,不管是不是真心实意,OAI和Anthropic选择闭源都说是为了安全)。

DeepSeek这一波操作,一下子破了圈,手机app冲上北美app store第一名,各大云厂商提供deepseek的api,产品接入,全民皆知。是极致的市场营销。这其中最重要的,我认为是增进了品牌价值和一部分消费者端的粘性,但可能没有构成很大的护城河。

我为什么这么说?如果几个月后任何一个其他的公司发布了一个超越V3/R1能力并且成本更低的大模型,会发生什么:

- 企业端

- 公司会集体切换到新的模型,如果是开源模型就自己部署,如果是闭源模型就上api

- 已经微调过模型的企业会基于新的模型重新做微调。

- 消费端

- 一些用户因为已经用了deepseek,会懒得切换到新的应用,但也有一些用户会马上切换

- 模型wrapper应用要么会把新的模型加入到可选模型里,要么就在后台直接切换到新的模型这体现出一个问题,就是大模型之间没有适配性差异,从一个模型切换到另外一个模型,对企业和对消费者的成本都非常低。

让我们来想想传统软件开源的优势是什么?

- 一是让更多的人参与到软件的改进中,比如说PyTorch开源后获得了学术界和业界非常多的贡献。

- 二是通过接口和行为的依赖让对用户进行锁定,然后在免费开源核心的基础上提供收费服务(主要是managed cloud hosting为形式)以获取利益,这个商业模式在过去十年重复太多遍了。典型的例子比如Gitlab, ElasticSearch, MongoDB, Kafka (Confluent)等等。这个模式成功的核心在于,一旦企业使用了一个开源项目一段时间,会对这个项目的借口和行为形成依赖,导致迁移到新解决方案的成本非常高,竞争对手必须要提供超出迁移成本的优越解决方案才有机会说服企业作出改变。可以说是一个非常聪明的商业模式。反过来看,开源大模型是否能利用这两个开源的优势还很难讲:

- 一,只开源参数不开源代码和数据,社群是没有办法帮助优化大模型本身的。微调过的开源模型可能可以通过huggingface这样的平台造成一些复用,但还是一样的问题,社群怎么来对开源微调模型做贡献呢?

- 二,大模型之间的迁移成本非常低,模型上侧接口都是一样的,下侧的部署和计算资源的调配也差不多,所以在模型行为差不多的时候迁移成本非常低。另外,怎么在免费提供的开源模型参数上开发收费的服务好像还没有什么人在尝试,是一个未知的问题。唯一知道的是像api调用这样的服务,通过云厂(火山)或者专业的模型服务厂(硅基流动)比模型厂自己更靠谱。

这里好像有一个突破口,有两个部分,非常难,但是可能可行:

- 保持模型在某一个特殊的能力上一直领先

- 围绕这个模型能力开发传统软件方案,和模型深度纵向集成

- 这两个部分都开源比如说,我的模型编程能力特别强(比如Sonnet),在迭代中我要一直保持它的这个能力行业第一,开源。然后基于这个能力,开发一个AI编程平台(类似Gitlab,Graphite,Cursor,等等),也开源。然后就可以在这个平台上设计收费功能,利用传统开源软件的优势了。

Enjoy Reading This Article?

Here are some more articles you might like to read next: